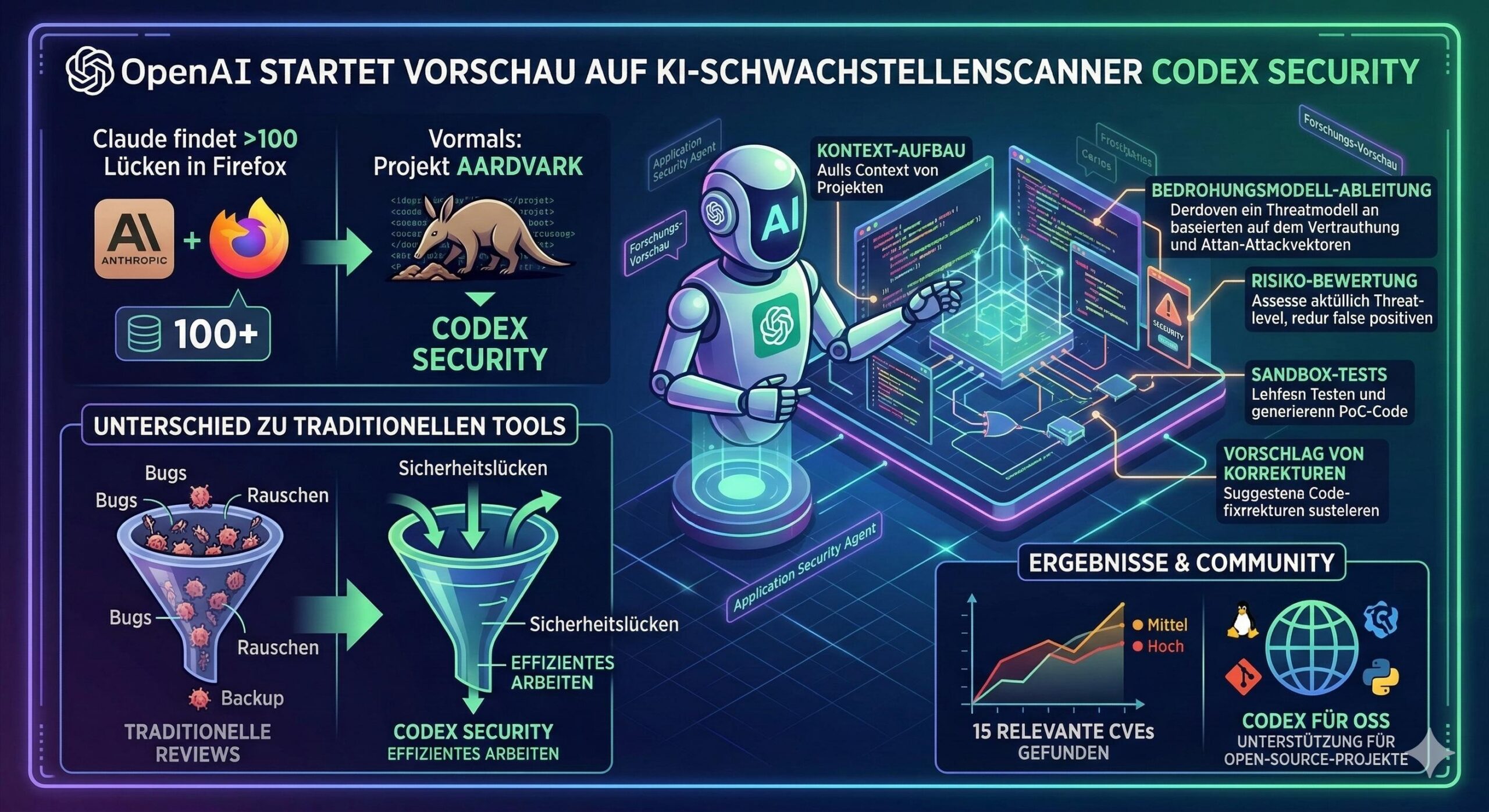

OpenAI hat mit „Codex Security“ eine Forschungs-Vorschau für einen KI-gestützten Schwachstellenscanner vorgestellt. Das System, das zuvor unter dem Namen „Aardvark“ in einer privaten Beta lief, soll Entwicklungsteams dabei helfen, Sicherheitslücken gezielter zu erkennen und deren tatsächliche Relevanz besser einzuschätzen.

Im Mittelpunkt steht ein Ansatz, der nicht nur einzelne Code-Stellen prüft, sondern zunächst den Kontext eines Projekts analysiert. Die KI soll sicherheitsrelevante Strukturen automatisch erfassen, daraus ein Bedrohungsmodell ableiten und auf dieser Basis nach möglichen Schwachstellen suchen. Ziel ist es, nicht nur möglichst viele Funde zu liefern, sondern vor allem die wirklich gefährlichen Risiken hervorzuheben.

Ein zentrales Problem in der Sicherheitsanalyse ist die große Zahl an Fehlalarmen und Meldungen mit geringer Bedeutung. Genau hier setzt Codex Security an: Die KI soll reale Angriffsflächen besser erkennen, die praktische Ausnutzbarkeit bewerten und damit Security-Teams bei der Priorisierung entlasten. Wenn möglich, werden gefundene Schwachstellen zusätzlich in Sandbox-Umgebungen getestet. Dadurch sollen Fehlbewertungen reduziert und die Ergebnisse aussagekräftiger werden.

Neben der Erkennung von Lücken liefert das System auch Vorschläge zur Behebung. Zusätzlich können Proof-of-Concepts entstehen, die Entwicklerinnen und Entwicklern helfen, Risiken schneller nachzuvollziehen und passende Gegenmaßnahmen umzusetzen. Damit positioniert OpenAI Codex Security als Werkzeug, das den Review-Prozess beschleunigen und die zunehmende Komplexität moderner Softwareentwicklung besser beherrschbar machen soll.

OpenAI berichtet bereits von ersten relevanten Funden in Open-Source-Projekten. Mehrere entdeckte Schwachstellen wurden dokumentiert, darunter auch Einträge mit höherem Risikopotenzial. Parallel dazu öffnet das Unternehmen sein Angebot für ausgewählte Open-Source-Projekte und stellt ihnen Zugriff auf weiterführende KI-Tools zur Verfügung.

Die Ankündigung zeigt, wie stark der Wettbewerb bei KI-gestützten Sicherheitstools zunimmt. Immer mehr Anbieter setzen darauf, dass künstliche Intelligenz nicht nur beim Programmieren hilft, sondern auch dabei, Sicherheitsprobleme frühzeitig zu erkennen, einzuordnen und schneller zu beheben.